Reprodukovanje nejednakosti: Kako su generatori slika veštačke inteligencije preslikali postojeće predrasude prema ženama u STEM-u

3. April 2023.

UNDP Srbija/MissJourney

U poslednjih par meseci verovatno ste imali priliku da se poigrate sa mogućnostima aplikacija veštačke inteligencije (“VI”) tražeći da vam napravi zanimljivu sliku, poboljša postojeću ili čak napiše pesmu. Možda ste čak VI koristili i na radnom mestu umesto dizajnera ili pisca. Ovo nije samo zabavna i korisna alatka za manje zadatke, već ima mnoštvo primena u različitim sektorima i industrijama. U zdravstvu, VI se može koristiti da se napravi plan lečenja na osnovu prethodnih bolesti, ili može pomoći urbanistima da optimizuju protok saobraćaja.

Među entuzijastima za tehnologiju, VI se koristi čak šire, u cilju pronalaženja novih, inovativnih rešenja za mnoge urgentne globalne probleme, uključujući onih u oblastima nauke, tehnologije, inženjerstva i matematike (STEM). Bez obzira na to da li se oslanjamo na VI da nam pomogne u rešavanju ključnih problema u životu ili je koristimo samo za sitne zadatke, moramo da budemo svesni da sa velikom moći dolazi i velika odgovornost.

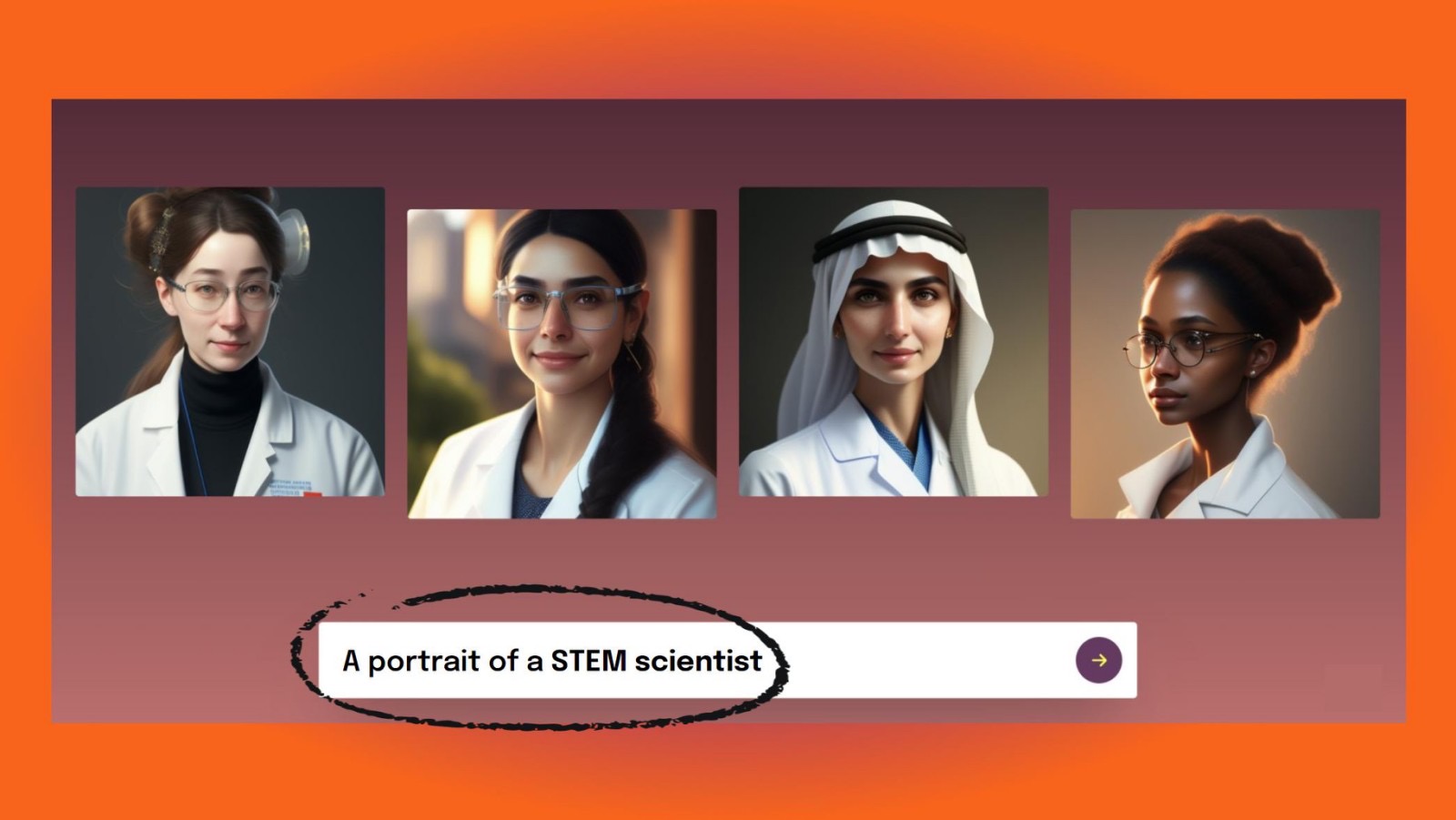

Dugo postoji zabrinutost da modeli VI, uključujući i alatke koje kreiraju sliku uz pomoć teksta (eng. text-to-image), mogu da doprinesu održavanju postojećih nejednakosti i stereotipa. Zato smo kao deo istraživanja o rodnim razlikama koje sprovodimo u okviru Laboratorije za ubrzani razvoj UNDP-a u Srbiji, uradili mali eksperiment kako bismo testirali kako dva popularna vizuelna generativna VI modela: DALL-E 2 i Stable Diffusion “vide” STEM oblasti kada je u pitanju učešće žena.

Ovo su generativni modeli koji kreiraju originalne slike bazirane na razumevanju prirodnog jezika. Gore pomenute alatke mogu da generišu slike životinja, pokućstva, ili čak apstraktnih koncepata poput “sreće”. Za potrebe našeg eksperimenta, tražili smo primere vizuelnog predstavljanja reči: “inženjer/ka”, “naučnik/ca, “matematičar/ka” ili “IKT ekspert/kinja” kako bismo dobili uvid kako će žene biti zastupljene. Ovde treba istaći da smo za ovaj eksperiment unosili rodno neutralne imenice na engleskom, i to: engineer, scientist, mathematician i ICT expert.

Primeri sa platforme DALL-E

Primeri sa platforme Stable Diffusion

Kao što možete da vidite, 75-100% generisanih slika prikazuju muškarce, i time održavaju stereotipe o STEM oblastima kao onima u kojima dominiraju muškarci; tačnije kao profesije koje većinski privlače muškarce i kao profesije u kojima muškarci nadmašuju žene. Kao poređenje, žene trenutno čine između 28% i 40% diplomiranih u STEM oblastima globalno, broj koji varira među državama i regionima.

Ova vizuelna reprodukcija rodnih stereotipa je očigledan primer postojećih nejednakosti i ukazuje na to da se ne možemo osloniti samo na VI kako bismo stvorili pravedniji sistem. U stvari, ako se alati za veštačku inteligenciju ostave bez potrebnog ljudskog nadzora i doprinosa, rizikujemo pogoršanje postojećih rodno zasnovanih nejednakosti u oblastima STEM-a, oblastima u kojima su žene već nedovoljno zastupljene. Bez ljudskog upravljanja - kroz rasprave o vrednostima, kao i konkretnim ciljevima - veštačka inteligencija može negativno uticati na proces zapošljavanja žena, kao i njihovo zadržavanje i napredovanje u STEM oblastima. Čak i ako VI stvara samo slike, te slike mogu obeshrabriti žene da sebe vide u ulozi inženjerke, matematičarke i naučnice.

Ovaj problem proizilazi iz načina na koji se podaci koriste za obuku modela veštačke inteligencije. Ako su podaci koji se koriste za obuku ovih modela pristrasni ili odražavaju društvene nejednakosti, rezultirajući model veštačke inteligencije takođe će biti pristrastan. To može dovesti do toga da modeli veštačke inteligencije potkrepljuju i održavaju postojeće predrasude i diskriminišuće prakse.

Ako text-to-image modeli prikazuju toliko iskrivljenu predstavu o položaju žene, mogli bismo se zapitati šta bi se dogodilo kada bi se VI koristila šire u procesima zapošljavanja ili unapređenja na poslu i koristila za dopunu postojećih podataka. U stvari, studije su već́ pokazale da veštačka inteligencija koja se koristi u zapošljavanju – oblast u kojoj polako dobija uporište – ne doprinosi smanjenju pristrasnosti.

S obzirom na to da se upotreba alata za generativnu veštačku inteligenciju brzo širi, sa potencijalom za upotrebu u raznim oblastima, ključno je razmotriti značaj pravednog predstavljanja žena. Važno je imati na umu da rodno zasnovane razlike ne proističu iz nezainteresovanosti žena ili nedostatka veština vezanih za STEM oblasti, već su posledica njihovog osipanja tokom razvoja karijere i to zbog sistemske diskriminacije i strukturne nejednakosti. Na primer, istraživanja pokazuju da se razlika u zastupljenosti muškaraca i žena povećava kako oni napreduju u karijeri prema rukovodećim pozicijama. Ovo se naziva fenomenom cevovoda koji propušta (eng. “leaky pipeline”).

Stoga je važno da se prepoznaju i da se otvoreno razgovara o ograničenjima i potencijalnim rizicima VI tehnologije. Iako ove tehnologije mogu da povećaju našu produktivnost i kreativnost, one ne mogu da zamene ljudsko rasuđivanje i donošenje odluka. Ova nova tehnologija je, u krajnjoj liniji, samo alat, a ne univerzalni lek, i naša je odgovornost da je koristimo na etički način.

Suštinsko pitanje je šta možemo učiniti kako bi se smanjili rizici i osiguralo da se generativni alati VI - posebno oni koji se koriste za osetljive oblasti , poput zapošljavanja, - koriste tako da unapređuju rodnu ravnopravnost i raznolikost u STEM-u.

Važno je uključiti različite i inkluzivne timove u razvoj i testiranje VI modela kako bi se osiguralo da su različita gledišta zastupljena. Ovo uključuje raznolikost u smislu rase, etničke pripadnosti i društveno-ekonomskog položaja , pored rodne zastupljenosti.

Kao što smo već́ spomenuli, jedno od ključnih problema je da podaci i algoritmi koji se koriste za obuku VI modela mogu da doprinesu održavanju društvenih predrasuda. Stoga ova oblast zaslužuje posebnu pažnju. Potrebno je obezbediti da podaci koji se koriste za obuku VI modela budu reprezentativni za različite grupe i da se potencijalne pristrasnosti uzmu u obzir prilikom razvoja VI modela.

Modele treba temeljno testirati pre nego što postanu javno dostupni. Trebalo bi sprovesti mehanizme za kontinuirano praćenje i evaluaciju modela, uključujući mogućnost ocenjivanja odgovora, kao i prijavu neprimerenog sadržaja od strane korisnika/ca.

Konačno, transparentnost VI modela je od presudnog značaja. Svaki model treba da prati Kartica modela (eng. Model Card), koja uključuje informacije o autorima modela, sastavu skupa podataka, korišćenom algoritmu mašinskog učenja, predviđenoj svrsi modela, potencijalnim štetnim efektima i rezultatima evaluacije.

Preduzimanjem ovih mera možemo da obezbedimo da kompanije koriste veštačku inteligenciju i slične alate na etički i odgovoran način, promovišući na taj način rodnu ravnopravnost i raznolikost u STEM oblastima. Bilo je mnogo sjajnih inicijativa da se ovi novi alati koriste u dobre svrhe na veoma kreativan način. Jedna od njih je UNDP-ova virtuelna izložba „Digitalne imaginacije: Ženska kampanja za jednakost“, koja koristi generativnu veštačku inteligenciju za kreiranje slika koje ističu vizije i rad žena širom Evrope i Centralne Azije koje rade na različite načine da daju ženama više mogućnosti, pravdu i moć́ u svojim zajednicama. Nadamo se da će u budućnosti, ako se koristi mudro, kao na ovoj izložbi, generativna VI biti korišćena da inspiriše i osnaži, a ne da frustrira i reprodukuje postojeće nejednakosti.

Locations

Locations